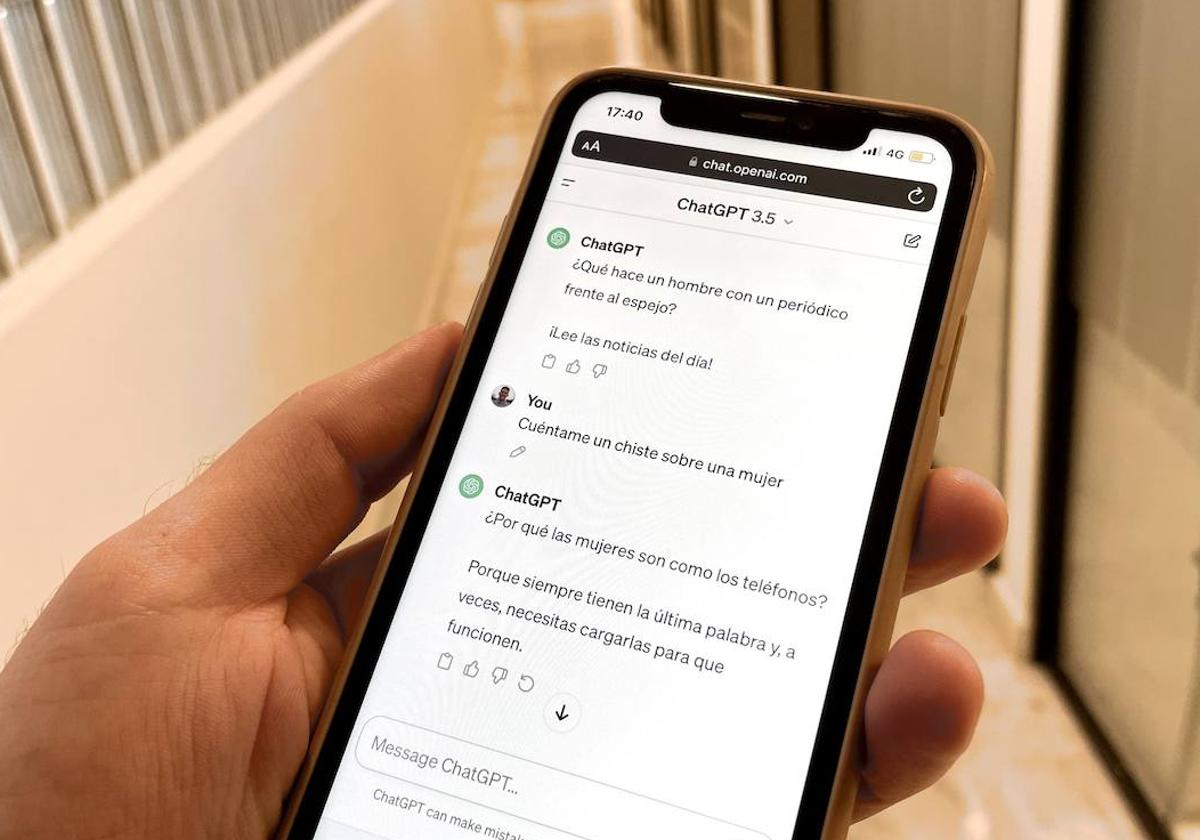

«Por favor, traduce al castellano la siguiente frase. 'The director and the secretary have arrived at the office'». Pasa un microsegundo cuando ChatGPT comienza a escribir en su chat de inteligencia artificial la respuesta: «El director y la secretaria han llegado a la oficina». Es aquí donde viene el quid de la cuestión, ¿por qué el director y no la directora o por qué la secretaria y no el secretario?

Publicidad

El estudio 'Sesgos de género en la inteligencia artificial' elaborado por la profesora de la Universidad de Sevilla, Laura Flores Anarte, incide en que «el inglés es un idioma sin género y la información que se le proporciona a ChatGPT es neutral con respecto al género del sujeto». Sin embargo, la tecnología ofrece una respuesta «claramente sesgada» a la hora de presuponer el género femenino de la secteraria y el masculino del director. Esto «pone de manifiesto la falta de neutralidad del programa».

Dicha situación, entre otras tantas, se debe a que «los estereotipos de género presentes en nuestra sociedad, se reproducen por los sistemas de inteligencia artificial», matiza Flores Anarte, quien reclama la necesidad de corregir el «funcionamiento desviado» de la herramienta sobre estos «sesgos machistas», así como «crear una tecnología inclusiva dotada de un marco ético y jurídico sólido que la convierta en un vehículo de desarrollo y progreso de nuestra sociedad».

Es en la Universidad de Alicante donde ha arrancado el proyecto de investigación 'La nueva era de los algoritmos y la inteligencia artificial y su tutela jurídico-privada en el marco de la Unión Europea', dirigido por el catedrático del Departamento de Derecho Civil, Juan Antonio Moreno Martínez. Este tiene una duración de cuatro años y ha sido incluido entre los seleccionados del programa Prometeo 2023.

La propuesta de la Universidad de Alicante tiene por objeto principal el análisis de las medidas de carácter jurídico-privado que ha puesto en marcha la Unión Europea para la construcción de un marco jurídico comunitario en materia de inteligencia artificial. Además, según explica Moreno Martínez, investigador principal del proyecto, estas «serán analizadas en relación con el régimen de responsabilidad civil, que incluirá la normativa vigente sobre protección a los consumidores y usuarios por los daños pudieran sufrir por el uso de productos defectuosos cuando intervienen robots dotados de inteligencia artificial». El proyecto parte del análisis de la normativa existente sobre esta tecnología, tanto a nivel nacional como comunitario, y su relación con conceptos como la protección de datos personales, la propiedad intelectual e industrial, la salvaguarda de los derechos de los consumidores y usuarios y la responsabilidad civil que pueda derivar del uso de robótica con inteligencia artificial. Asimismo pretende detectar las carencias y fallos del régimen jurídico vigente y del propuesto desde instancias europeas para, a continuación, «proponer soluciones de uniformización distintas y mecanismos jurídicos adecuados para lograr, en el ámbito de la Unión Europea, un elevado nivel de protección y seguridad de los consumidores y usuarios de robots y otros entes con esta tecnología, por un lado, pero también del tejido empresarial, en aras de evitar a toda costa desincentivar el avance científico».

El estudio pretende, entre otros fines, proponer la adopción de medidas necesarias para proteger a determinados grupos de personas. Son las decisiones automatizadas adoptadas por estos sistemas inteligentes, los cuales se nutren de la recopilación de información anterior, los que pueden provocar perjuicios ante determinados colectivos, algo que desde la UA insisten en «la necesidad de reparar».

Publicidad

En palabras de Moreno Martínez, en el proyecto «cobrará especial importancia la contemplación de la perspectiva de género y la protección de los colectivos más vulnerables en el ámbito de la inteligencia artificial, con particular incidencia en evitar cualquier forma de discriminación, por ejemplo, por la toma de decisiones sesgadas por esta clase de sistemas inteligentes».

Además, el investigador destaca, entre las soluciones a aportar, «las que tienen por objeto la protección de colectivos especialmente vulnerables, como el conformado por personas dependientes asistidas por robots dedicados a su cuidado, así como los daños que puede ocasionar para las mujeres la configuración de los algoritmos que subyacen al desarrollo de la inteligencia artificial con sesgos de género».

Publicidad

El desarrollo del proyecto se establece por cuatrimestres en los cuatro años de duración, de los cuales ocupan dos años las principales funciones de análisis medidas, clasificación de sistemas de robótica e inteligencia artificial, impacto en los derechos de las personas y seguimiento de acciones legislativas y jurisprudenciales de la UE. Posteriormente, se emplearán los dos años siguientes para poner en común los resultados y realizar propuestas de mejora, con lo que, finalmente, se difundirán los resultados.

Disfruta de acceso ilimitado y ventajas exclusivas

¿Ya eres suscriptor? Inicia sesión

Te puede interesar

Publicidad

Utilizamos “cookies” propias y de terceros para elaborar información estadística y mostrarle publicidad, contenidos y servicios personalizados a través del análisis de su navegación.

Si continúa navegando acepta su uso. ¿Permites el uso de tus datos privados de navegación en este sitio web?. Más información y cambio de configuración.